DeepSeek V4 : NVIDIA assure le support Blackwell à 3 500 tokens/s

charles

Publié le 26 April 2026 · 3 min de lecture

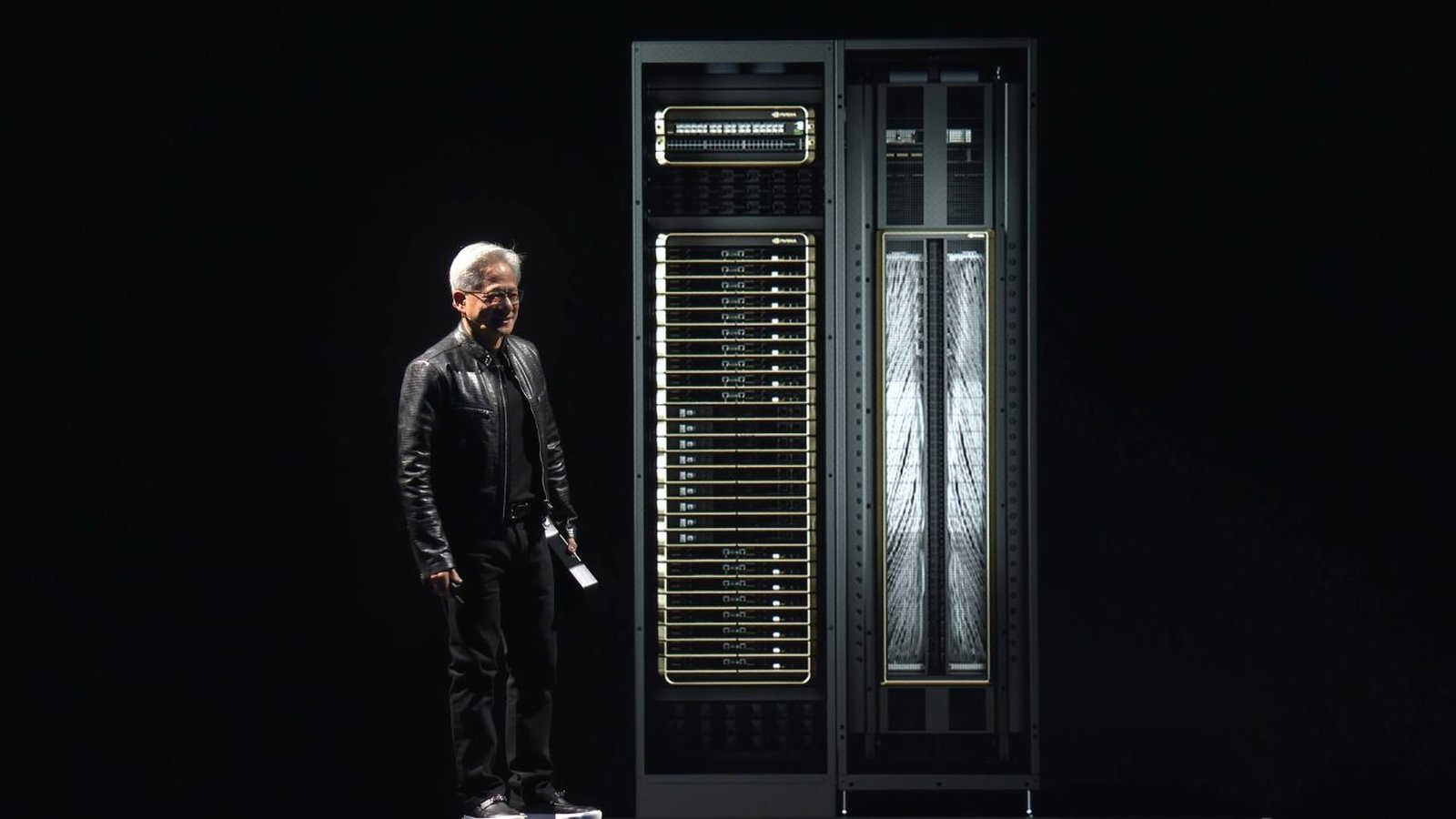

NVIDIA a anticipé le lancement de DeepSeek V4 en proposant un support immédiat de ses GPU Blackwell, sans période d'adaptation. Les premières mesures de performance ont été communiquées par l'entreprise dès la disponibilité du modèle.

Cette réactivité s'inscrit dans un contexte de compétition accrue autour des modèles d'inférence à très grande échelle, où la vitesse de déploiement devient un critère déterminant pour les opérateurs de centres de données.

DeepSeek V4, deux modèles aux architectures distinctes

DeepSeek V4 se décline en deux variantes : un modèle Pro à 1 600 milliards de paramètres et une version Flash à 284 milliards. Les deux sont conçus pour réduire les exigences de calcul par rapport aux générations précédentes.

Le modèle consomme 27 % des opérations à virgule flottante nécessaires pour l'inférence d'un seul token, et seulement 10 % de l'espace de cache KV lors d'un contexte d'un million de tokens. Ces réductions allègent significativement la charge mémoire à grande échelle.

La quantification FP4, plus précisément MXFP4, joue un rôle central dans ces gains. Elle compresse les représentations numériques des poids du modèle, ce qui réduit le trafic mémoire et la latence d'échantillonnage lors de l'inférence.

Jusqu'à 3 500 tokens par seconde sur GB300

Selon les données présentées par NVIDIA, le GPU GB300, aussi appelé Blackwell Ultra, atteint un débit proche de 3 500 tokens par seconde pour DeepSeek V4. L'entreprise précise que ces chiffres sont préliminaires et devraient progresser avec les optimisations à venir.

La pile logicielle Blackwell mobilise plusieurs technologies pour ce résultat : la précision NVFP4, l'outil d'orchestration Dynamo, des noyaux CUDA optimisés et des techniques de parallélisation avancées. NVIDIA propose également ces capacités via ses microservices NIM et ses flux de fine-tuning.

L'entreprise positionne Blackwell comme une plateforme adaptée aux modèles dépassant le billion de paramètres, avec une gestion de contexte long allant jusqu'à un million de tokens en conditions réelles de déploiement.

La compatibilité MXFP4 dépasse les frontières matérielles

Un élément notable concerne les futurs processeurs Ascend d'Huawei. Les puces Ascend 950PR et Ascend 950DT, dont le lancement est prévu en 2026, intègrent elles aussi des instructions MXFP4.

Cela signifie que DeepSeek V4 sera techniquement compatible avec ces accélérateurs domestiques chinois, sans modification du modèle. La standardisation autour de MXFP4 pourrait ainsi faciliter le déploiement de V4 sur un spectre matériel plus large que les seuls GPU NVIDIA.

Cette compatibilité croisée reflète une tendance plus large : les formats de quantification basse précision deviennent des standards de fait dans l'écosystème des grands modèles de langage.

Des optimisations encore attendues

Les chiffres actuels de 3 500 tokens par seconde constituent un point de départ, non un plafond. NVIDIA indique que son équipe travaille à affiner davantage la pile logicielle pour DeepSeek V4, notamment au niveau du co-design entre le matériel et le modèle.

L'entreprise est également décrite comme contributrice active à l'écosystème open source, avec plusieurs centaines de projets publiés sous licences ouvertes. DeepSeek V4 s'inscrit dans cette logique de modèles ouverts que NVIDIA cherche à optimiser en priorité lors de chaque lancement majeur.

Source : WCCFTech