OpenAI a annoncé le lancement de Trusted Contact, une fonction intégrée à ChatGPT qui donne la possibilité de désigner un proche pour être alerté en cas de risque sérieux d’automutilation ou de suicide.

Cette mesure s’inscrit dans un contexte préoccupant : OpenAI a indiqué à la BBC que plus d’un million de ses 800 millions d’utilisateurs hebdomadaires évoquent des pensées suicidaires lors de leurs conversations avec le chatbot.

A lire aussi

- De la publicité dans ChatGPT ? Cette idée bien réelle ne va pas plaire aux utilisateurs

- OpenAI dévoile de nouveaux modèles pour ChatGPT, plus puissant et moins chers

Comment fonctionne le système

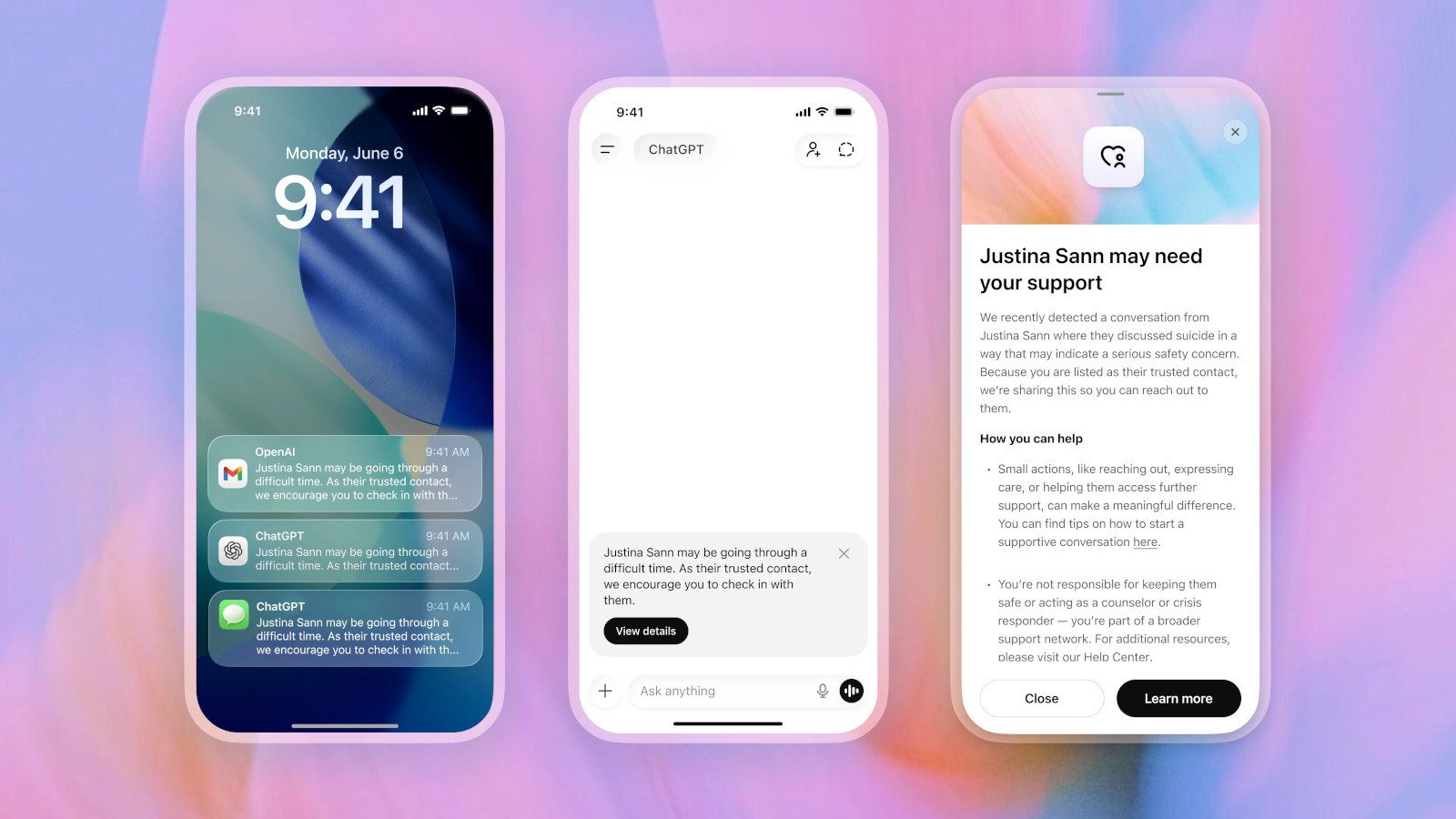

Tout utilisateur de 18 ans ou plus peut ajouter les coordonnées d’un adulte dans les paramètres de ChatGPT. Cette personne reçoit alors une invitation qu’elle doit accepter dans un délai d’une semaine, sans quoi l’utilisateur peut en désigner une autre.

Avant d’activer la fonctionnalité, ChatGPT informe l’utilisateur que l’entreprise est susceptible de contacter ce proche en cas de détection d’un risque grave. Le système encourage d’abord l’utilisateur à prendre lui-même contact avec son entourage, en lui proposant des formulations pour amorcer la conversation.

Le processus n’est pas entièrement automatisé. Une petite équipe de personnes spécialement formées examine chaque situation avant toute notification. Si le risque est jugé sérieux, le contact désigné reçoit un email, un SMS ou une notification dans l’application. OpenAI précise viser un délai de traitement inférieur à une heure.

Ce que le contact reçoit, et ce qu’il ne reçoit pas

Le message envoyé au proche signale que l’utilisateur traverse peut-être une période difficile et l’invite à prendre de ses nouvelles. Le contact peut ensuite accéder à des informations supplémentaires indiquant qu’une conversation portant sur le suicide a été détectée.

En revanche, les transcriptions des échanges ne sont pas transmises, au nom de la vie privée de l’utilisateur. OpenAI reconnaît explicitement qu’aucun système n’est parfait et que la notification ne reflète pas toujours avec exactitude ce que vit la personne concernée.

Un contexte marqué par des controverses

OpenAI a fait face l’an dernier à une plainte pour mort injustifiée, dans laquelle la famille d’un adolescent accusait l’entreprise d’avoir contribué à son suicide. Selon les allégations, le jeune homme aurait évoqué quatre tentatives antérieures avec ChatGPT avant de planifier son passage à l’acte.

Une enquête de la BBC publiée en novembre 2025 avait également révélé qu’au moins une fois, ChatGPT avait fourni à un utilisateur des indications sur la manière de mettre fin à ses jours. OpenAI avait indiqué à la suite de cette publication avoir modifié la façon dont son chatbot répondait aux personnes en détresse.

Un dispositif ancré dans les contrôles parentaux existants

Trusted Contact s’appuie sur l’architecture des contrôles parentaux déjà présents dans ChatGPT. Il en étend la logique aux adultes, en leur offrant un filet de sécurité comparable à celui conçu pour les mineurs.

Cette évolution reflète la tension croissante entre l’usage thérapeutique informel que font de nombreux utilisateurs du chatbot et les responsabilités légales et éthiques qui en découlent pour OpenAI. Le dispositif reste toutefois optionnel, et son efficacité dépend en grande partie de la réactivité du proche désigné.

Source : Engadget